Từ Mạng Neuron Đến Transformer: Cuộc Cách Mạng Kiến Trúc Thay Đổi Thế Giới AI

Trong kỷ nguyên của ChatGPT và những AI tạo sinh mạnh mẽ, có bao giờ bạn tự hỏi: "Điều gì thực sự diễn ra dưới nắp ca-pô?". Hành trình từ những mạng neuron (Neural Networks) đơn giản đến kiến trúc Transformer hiện đại không chỉ là sự nâng cấp về phần cứng, mà là một cuộc cách mạng về tư duy thuật toán.

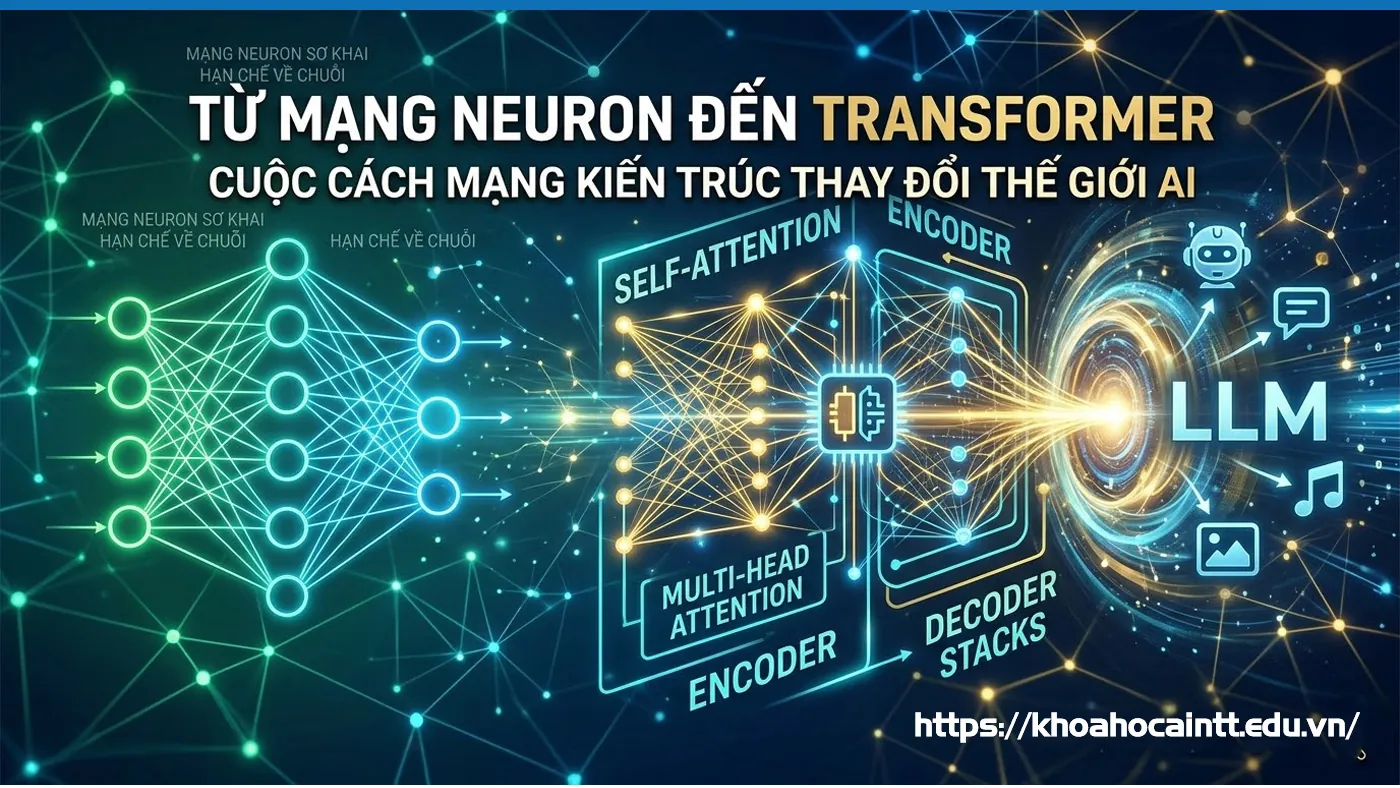

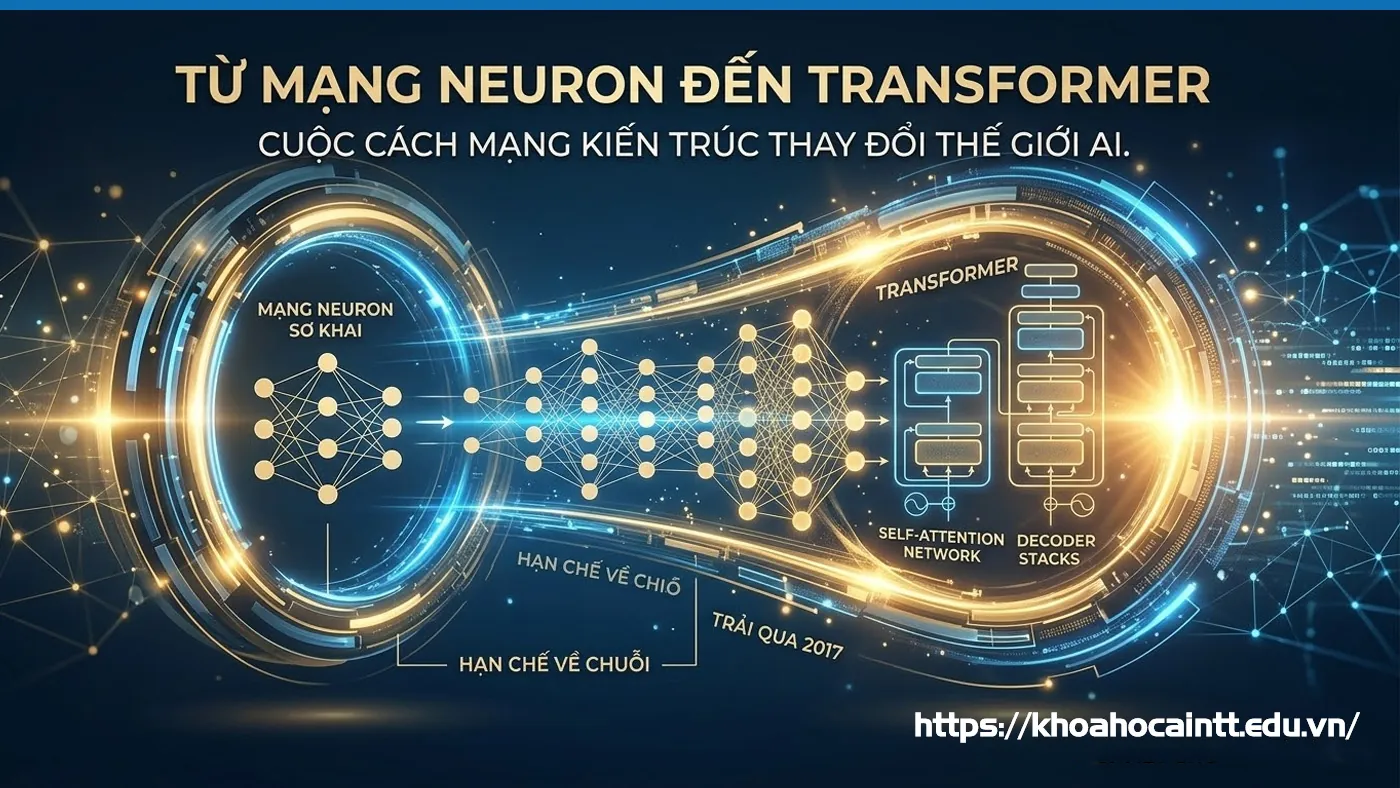

1. Mạng Neuron Nhân Tạo (Neural Networks) – Những Viên Gạch Đầu Tiên

Mạng Neuron nhân tạo (ANN) được truyền cảm hứng từ cấu trúc não bộ con người. Về bản chất, đây là các lớp "nút" (neurons) kết nối với nhau, nơi mỗi kết nối có một trọng số (weight) nhất định.

-

Cơ chế: Dữ liệu đi vào (Input), qua các lớp ẩn (Hidden Layers) để xử lý và đưa ra kết quả (Output).

-

Hạn chế: Các mạng neuron truyền thống rất giỏi nhận diện hình ảnh hoặc phân loại dữ liệu đơn giản, nhưng lại "hụt hơi" khi đối mặt với dữ liệu có tính chuỗi như ngôn ngữ tự nhiên.

2. Sự Trỗi Dậy Và Giới Hạn Của RNN và LSTM

Để xử lý ngôn ngữ, các nhà khoa học đã tạo ra RNN (Recurrent Neural Networks). Khác với ANN, RNN có khả năng "ghi nhớ" những gì đã xảy ra trước đó.

Tuy nhiên, RNN gặp phải hai vấn đề chí mạng:

-

Vấn đề mất mát đạo hàm (Vanishing Gradient): Khi câu quá dài, AI sẽ quên mất thông tin ở đầu câu.

-

Xử lý tuần tự: AI phải đọc từ đầu tiên rồi mới đến từ thứ hai, điều này làm tốc độ huấn luyện cực kỳ chậm.

3. Bước Ngoặt Mang Tên Transformer (2017)

Năm 2017, Google công bố bài báo lịch sử "Attention Is All You Need", giới thiệu kiến trúc Transformer. Đây chính là "trái tim" của hầu hết các mô hình AI hiện nay như GPT, Claude hay Gemini.

Cơ chế Self-Attention: Chìa khóa của sự thông minh

Khác với việc đọc tuần tự, Transformer sử dụng cơ chế Self-Attention (Tự chú ý). Nó cho phép mô hình nhìn vào toàn bộ câu cùng một lúc và xác định mối quan hệ giữa các từ, bất kể chúng cách xa nhau bao nhiêu.

-

Ví dụ: Trong câu "Ngân hàng đã từ chối đơn vay vì họ cảm thấy rủi ro", Transformer sẽ biết từ "họ" đang ám chỉ "ngân hàng" chứ không phải "đơn vay" nhờ vào trọng số chú ý cực kỳ chính xác.

Khả năng tính toán song song (Parallelization)

Vì không phải chờ đợi từng từ một, Transformer có thể tận dụng tối đa sức mạnh của hàng nghìn chip GPU cùng lúc. Điều này giúp việc huấn luyện trên quy mô dữ liệu khổng lồ (toàn bộ Internet) trở nên khả thi.

4. Tại Sao Transformer Lại Tạo Nên Cuộc Cách Mạng AI?

Sự chuyển dịch từ RNN sang Transformer không chỉ là thay đổi công thức toán học, mà nó tạo ra ba thay đổi lớn:

-

- Khả năng mở rộng (Scalability): Càng thêm nhiều dữ liệu và tham số, AI càng thông minh hơn mà không bị bão hòa.

-

- Sự hiểu biết ngữ cảnh: AI không còn hiểu máy móc theo từng từ đơn lẻ mà hiểu được sắc thái, ngữ cảnh sâu sắc của toàn bộ văn bản.

-

- Đa phương thức (Multimodal): Kiến trúc này không chỉ áp dụng cho văn bản mà còn mở rộng sang hình ảnh (Vision Transformer) và âm thanh.

5. Kết Luận

Từ những mạng neuron sơ khai đến sự thống trị của Transformer, chúng ta đã đi một quãng đường dài để dạy máy tính cách "tư duy" như con người. Hiểu về Transformer không chỉ giúp bạn nắm bắt công nghệ hiện tại, mà còn là nền tảng để đón đầu những đột phá tiếp theo trong tương lai của AGI.